百度爬虫它是一个自动的程序,对内容的抓取路径与蜘蛛丝类似,通过网页的锚文本链接进行爬行抓取,所以我们也称为百度蜘蛛,它抓取网页中的内容、图片、文字等,抓取后对其分类和整理,所以网站必需有蜘蛛来访并被抓取才有可能在搜索结果页展现出来。

一、百度爬虫的作用:

搜索引擎通过蜘蛛这个自动程序,访问各类网站,爬虫首先判断这个网页是不是符合收录条件,如果符合,百度爬虫会下载该网页,然后保存到百度数据里,建立百度快照,当用户搜索某一个关键词时,通过自身的排序机制,把快照进行索引排序,然后把排序结果展现给用户。如果网页内容不符合搜索引擎的收录规则,那么百度爬虫不收录,并通过链接访问其他页面,重新对页面进行判断是否收录。

二、针对百度爬虫有以下优化策略:

1、增加链接的发现机率

将新网页主动提交给百度无疑是一个缩短蜘蛛发现机率的方法,但蜘蛛来了不一定保证会收录,还要看页面代码、内容质量、排版、标题等。另一方面,从逻辑上讲,网站的外链越多,爬虫发现并到访的机率也就越大,所以在一些高权重站留下外链是可取的。

2、增加有效收录数量及排名页占比

这一点需要有持续的优质内容输出,内容要符合白皮书要求,这样一方面可以增加有效的收录数量,另一方面会增加搜索的曝光率,也就是有很多词参与了排名,这样才会吸引蜘蛛不断来访。

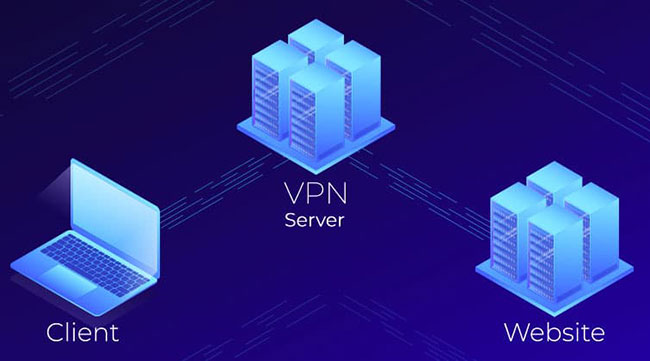

3、网站使用独立IP地址

每天爬虫对一个IP的抓取频度是有限的,使用共享IP很可能分到你站点的IP就没多少了,另外也有可能受其它站的影响,比如有违规网站,连带惩罚后就不会有多少爬虫来访问。

4、注意内容的更新频度

比如你网站刚开始每天发100篇文章,爬虫来得很勤快,后面每天只发了几篇,有时不更新,这样久而久之爬虫来的频度会慢慢下降,所以保持更新频度是蜘蛛稳定来访的关键之一。

5、保证网页的打开速度

这一点相信大家都比较清楚,选用的服务器必需稳定,不经常出现机房被攻击、线路出问题等情况,最好有CDN加速,保证网页的打开速度是百度爬虫顺畅到访的前提,如果经常出现打不开或高延迟,蜘蛛来访频度肯定会下降。

通过以上几点分享,我们知道了网站要做哪些优化对百度爬虫有利,我们要注意网站页面的数量多,并不代表蜘蛛访问频率就会高,而是有快照、有排名的页面数越多,证明网站质量越好被索引的页面多,蜘蛛访问频率会越高。另外还要注意网站链接层级的合理性,层级过多也不利于蜘蛛抓取。

还木有评论哦,快来抢沙发吧~